هوش مصنوعی مفاهیم به اشتراک گذاشتهشده در ویدئو، صدا و متن را میآموزد!

آیا هوش مصنوعی توانایی تفسیر اطلاعات فایلها با فرمتهای متفاوت و درک اعمال و داده های مشابه بین آنها را دارد؟

یک مدل یادگیری ماشینی (ماشین لرنینگ) میتواند اطلاعات و اعمال را در یک کلیپ ویدیویی شناسایی کرده و بدون کمک انسان به آن برچسب بزند.

محققان MIT یک تکنیک یادگیری ماشین (ماشین لرنینگ) ایجاد کردند که یاد میگیرد داده ها را به گونهای نمایش دهد که مفاهیمی را که بین روشهای بصری و صوتی به اشتراک گذاشته میشوند، نشان دهد. مدل آنها میتواند مکان عمل خاصی را در یک ویدیو شناسایی کند و آن را برچسبگذاری کند.

انسانها دنیا را از طریق ترکیبی از روشهای مختلف مانند بینایی، شنوایی و درک از زبان مشاهده میکنند. از سوی دیگر، ماشینها جهان را از طریق داده هایی که الگوریتمها میتوانند پردازش کنند، تفسیر میکنند.

بنابراین، هنگامی که یک ماشین یک عکس را میبیند، باید آن عکس را در داده هایی که میتواند برای انجام وظیفهای مانند طبقهبندی تصویر استفاده کند، رمزگذاری کند. این فرآیند زمانی پیچیدهتر میشود که ورودیها در قالبهای مختلف مانند فیلمها، کلیپهای صوتی و تصاویر ارائه شوند.

الکساندر لیو، دانشجوی فارغ التحصیل در آزمایشگاه علوم کامپیوتر و هوش مصنوعی (CSAIL) و اولین نویسنده مقالهایست که به این مشکل پرداختهاست.

او می گوید: «چالش اصلی در اینجا این است که چگونه یک ماشین میتواند آن روش و حالات مختلف را هماهنگ کند؟ به عنوان انسان، این برای ما آسان است. ما یک ماشین را میبینیم و سپس صدای ماشینی را میشنویم که از کنار آن میگذرد و میدانیم که اینها یکسان هستند اما برای یادگیری ماشین، این کار چندان ساده نیست.

لیو و همکارانش تکنیک هوش مصنوعی را توسعه دادند که یاد میگیرد داده ها را به گونهای نمایش دهد که مفاهیمی را که بین روشهای بصری و صوتی به اشتراک گذاشته میشوند، نشان دهد.

به عنوان مثال، روش آنها میتواند یاد بگیرد که عمل گریه نوزاد در یک ویدیو با کلمه گفتاری “گریه” در یک کلیپ صوتی مرتبط است.

با استفاده از این دانش، مدل یادگیری ماشینی آنها میتواند تشخیص دهد که یک عمل خاص چه زمانی در ویدیو انجام میشود و آن را برچسبگذاری کند.

این تکنیک روزی می تواند برای کمک به ربات ها در یادگیری مفاهیم و اطلاعات موجود در جهان، و بیشتر شبیه به شیوه انسانها، یعنی از طریق ادراک، مورد استفاده قرار گیرد.

بازنمایی های یادگیری

بازنمایی های یادگیری

محققان کار خود را بر روی یادگیری بازنمایی متمرکز میکنند، که نوعی یادگیری ماشینی است که به دنبال تغییر دادههای ورودی است تا انجام کاری مانند طبقهبندی یا پیشبینی را آسانتر کند.

مدل یادگیری بازنمایی، داده های خام، مانند ویدیوها و زیرنویسهای متنی مربوط به آنها را میگیرد و با استخراج ویژگیها یا مشاهدات در مورد اشیا و اقدامات در ویدیو، آنها را رمزگذاری میکند. سپس آن نقاط داده را در یک شبکه، که به عنوان فضای جاسازی (فضای توسعه) شناخته میشود، نگاشت میکند. مدل دادههای مشابه را به عنوان نقاط منفرد در شبکه با هم خوشهبندی میکند. هر یک از این نقاط داده یا بردارها با یک کلمه جداگانه نشان داده میشوند.

به عنوان مثال، یک کلیپ ویدیویی از یک شخص که در حال شعبده بازی است، ممکن است به بردار با عنوان “شعبدهبازی” نگاشت شود.

محققان این مدل را محدود می کنند تا فقط از ۱۰۰۰ کلمه برای برچسبگذاری بردارها استفاده کند. مدل میتواند تصمیم بگیرد که کدام اقدامات یا داده و اطلاعات را میخواهد در یک بردار رمزگذاری کند، اما فقط میتواند از ۱۰۰۰ بردار استفاده کند. مدل کلماتی را انتخاب می کند که فکر می کند به بهترین شکل نشان دهنده داده ها و اطلاعات هستند.

روش آنها به جای رمزگذاری داده ها از روشهای مختلف در شبکههای جداگانه، از یک فضای جاسازی مشترک استفاده میکند که در آن دو مدالیته و روش میتوانند با هم کدگذاری شوند. این مدل را قادر میسازد تا رابطه بین بازنماییها را از دو حالت بیاموزد، مانند ویدیویی که یک شخص را در حال شعبده بازی نشان میدهد و صدای ضبط شدهای از فردی که میگوید «شعبدهبازی».

برای کمک به پردازش داده ها از چندین روش، آنها الگوریتمی طراحی کردند که ماشین را راهنمایی میکند تا مفاهیم و اطلاعات مشابه را در یک بردار رمزگذاری کند.

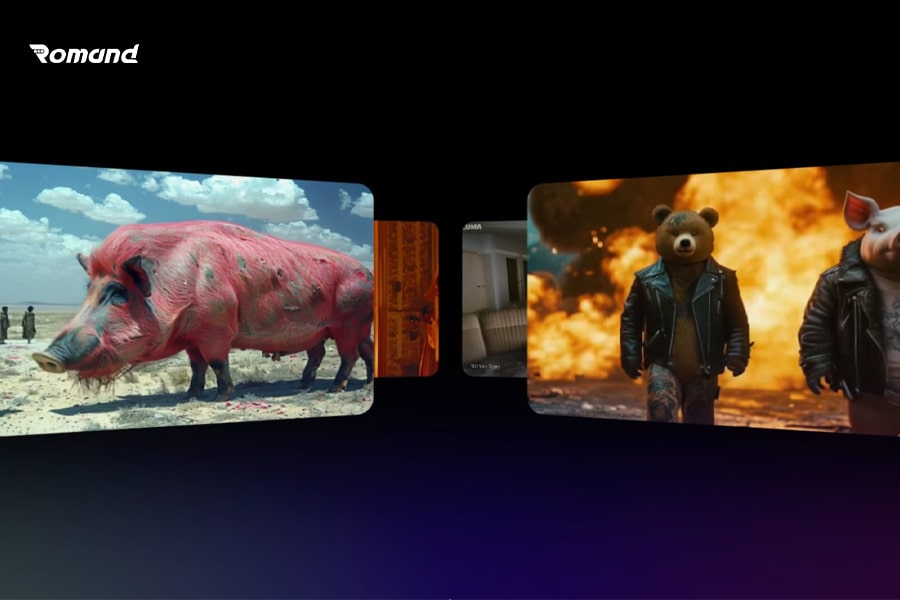

لیو توضیح میدهد:(( اگر ویدیویی درباره خوکها وجود دارد، مدل ممکن است کلمه «خوک» را به یکی از ۱۰۰۰ بردار اختصاص دهد. سپس اگر مدل در یک کلیپ صوتی از فردی بشنود که کلمه «خوک» را به کار میبرد، همچنان باید از همان بردار برای رمزگذاری آن استفاده کند.))

یک بازیابی بهتر

یک بازیابی بهتر

آنها مدل را بر روی وظایف بازیابی متقابل با استفاده از سه مجموعه داده آزمایش کردند: یک مجموعه داده متنی-ویدیویی با کلیپ های ویدیویی و زیرنویس متنی، یک مجموعه داده ویدیویی-صوتی با کلیپهای ویدیویی و زیرنویس صوتی گفتاری، و یک مجموعه داده تصویری-صوتی با تصاویر و صدای گفتاری زیرنویسها.

به عنوان مثال، در مجموعه داده های ویدئویی-صوتی، مدل ۱۰۰۰ کلمه را برای نمایش اعمال در ویدئوها انتخاب کرد. سپس، هنگامی که محققان به آن پرسشهای صوتی دادند، مدل سعی کرد کلیپی را پیدا کند که بهترین تطابق را با آن کلمات گفتاری داشته باشد.

لیو میگوید:(( درست مانند جستجوی گوگل، شما متنی را تایپ میکنید و دستگاه سعی میکند مرتبطترین چیزهایی را که جستجو میکنید به شما بگوید. فقط ما این کار را در فضای برداری انجام میدهیم.))

نه تنها با استفاده از تکنیک آنها احتمال درست یافتن اطلاعات بیشتر از مدلهایی بود که با آن مقایسه کردند، بلکه درک آن نیز آسانتر بود.

از آنجایی که این مدل تنها میتوانست از ۱۰۰۰ کلمه برای برچسبگذاری بردارها استفاده کند، کاربر میتواند راحتتر ببیند که دستگاه از کدام کلمات استفاده کرده تا نتیجه بگیرد که ویدیو و کلمات گفته شده مشابه هستند. لیو میگوید که:(( این میتواند کاربرد این مدل را در موقعیتهای واقعی آسانتر کند، جایی که درک کاربران از نحوه تصمیمگیری، ضروری است.))

این مدل هنوز دارای محدودیتهایی است که امیدوارند در کارهای آینده به آنها رسیدگی شود.

لیو به عنوان مثال به این موضوع اشاره کرد که تحقیقات آنها بر روی دادههای دو روش و حالت در یک زمان متمرکز بود، اما در دنیای واقعی انسانها به طور همزمان با بسیاری از روش و حالات متفاوتِ داده مواجه میشوند.

او می افزاید:(( و ما میدانیم که ۱۰۰۰ کلمه روی “این نوع مجموعه داده ” کار میکند، اما نمیدانیم که آیا میتوان آن را به “دنیای واقعی” تعمیم داد یا نه.))

بهعلاوه، تصاویر و ویدئوها در مجموعه دادههایشان حاوی اشیاء ساده یا اقدامات ساده بودند. اما داده و اطلاعات دنیای واقعی بسیار آشفتهتر هستند. آنها همچنین میخواهند تعیین کنند که در صورت وجود تنوع گستردهتری از ورودیها، روش آنها چقدر افزایش مییابد.

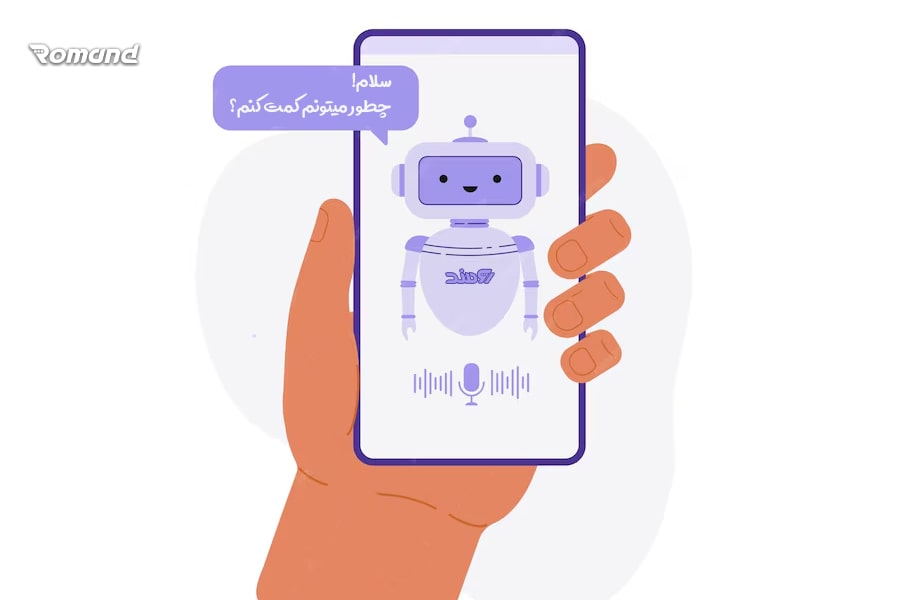

تاثیر و رشد شگفتانگیزی که در سالهای اخیر از هوش مصنوعی در پردازش، تفسیر و ارائه اطلاعات شاهد بودیم بر هیچکس پوشیده نیست. و حالا در جایگاهی ایستادهایم که افراد و کمپانیهای بزرگی به هوش مصنوعی اعتماد کردهاند و وظایف متفاوت و متنوعی را به هوش مصنوعی سپردهاند. از جمله پرطرفدارترین این شاخهها چتبات ها و استفاده از آنها در بخش پشتیبانی مشتری و مخاطبان و پاسخگویی هوشمند و خودکار به آنهاست.

کمپانیهای بزرگ و کوچک حالا برای افزایش سرعت و دقت روند پاسخگویی و راهنمایی به مشتریان خود، کاهش هزینهها، افزایش بهرهوری و تمرکز نیروی پشتیبانی انسانی برای امور حیاتیتر و پشتیبانی ۲۴/۷، چتبات ها را به عنوان دستیار هوشمند خود انتخاب کردهاند.

برای بررسی و آشنایی بیشتر با این دستیارهای هوشمند کسب و کارتان کلیک کنید.

منبع مقاله: وبسایت MIT News